Deepfake也存在一些危险:人工智能的阴暗面

摘要:近年来,随着机器学习技术的不断发展,人们对 Deepfake图像的研究也越来越多。由于对这些图像的不了解,我们也可能陷入其中。了解 Deepfake图像可能会带来严重的后果。

01

大家好!我是印修。

HAPPY NEW YEAR

这篇文章的主题是人工智能领域中的深度造假图像问题以及它们对女性的潜在影响。虽然人工智能为创新和创造力开辟了新途径,但它也被用来创建与现实几乎无法区分的经过操纵的图像和视频。

02

这篇文章

HAPPY NEW YEAR

在这篇文章里,我们将探讨深度造假图像如何被滥用以及它们给社会中的女性带来的具体担忧。

03

让我们来看看什么是深度造假图像?

HAPPY NEW YEAR

深度造假图像是一种合成媒体,通过使用强大的人工智能算法将一个人的肖像叠加到另一个人的肖像上,从而创建逼真但伪造的视频和图像。

04

我们将探讨以下几个方面:

HAPPY NEW YEAR

深度造假技术是如何工作的?

深度造假技术给社会中的女性带来了哪些具体担忧?

05

Deepfake技术

HAPPY NEW YEAR

Deepfake技术最早被用来制作虚假图像和视频,用于制作虚假的名人照片和视频,如盖尔·加朵、泰勒·斯威夫特、斯嘉丽·约翰逊等。但目前很少有人利用这个技术来传播错误信息、身份盗窃和最糟糕的报复性色情内容。

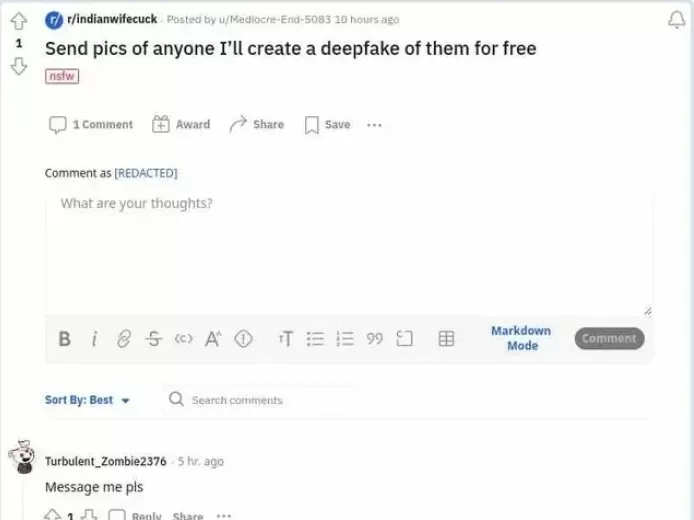

在 Reddit社区,已经禁止了 Deepfake技术,并增加了针对“未经同意的亲密媒体”(ENI)的新规则。ENI是一种旨在保护个人隐私和尊重他人权利、尊重自己和他人隐私等方面提出法律要求的网站或社交媒体平台。

Deepfake是一种合成媒体,它通过深度生成方法操纵面部外观。它利用强大的人工智能算法,可以创建逼真但伪造的视频和图像。在过去几年中,深度造假技术被用于娱乐目的,比如电影或病毒视频交换面孔。它也被用于过滤用户喜爱的照片和视频,但很少有人使用它来传播错误信息、身份盗窃和最糟糕的报复性色情内容。

对女性公众人物而言,他们在社交媒体上所暴露出来的身份被剥削和玷污、名誉受损、安全感受损。在 Reddit、 Discord和 Matrix等平台上,有数百个专门创作女性名人色情内容的社区,它们为了吸引用户,会积极地鼓励对女性名人的侮辱和冒犯性言论,还有人会要求对普通女性进行深度伪造。

06

人工智能

HAPPY NEW YEAR

在人工智能和 Deepfakes的新时代,女性和普通女性将不会受到任何形式的剥削。而对于那些支持女性权益的人来说,这也意味着对人工智能和 Deepfake机器人的新时代。

Telegram的盗版和 Deepfake机器人激增是紧迫问题

这些机器人向个人提供深度虚假色情服务,只需少量资金,任何人都可以轻松访问。

这种可访问性带来了有害内容的巨大风险,特别是对于个人(尤其是女性)未经同意的情况。如果在 Telegram上发现任何任何此类机器人,需要从应用程序中报告这些机器人的输出图像为“色情”。Telegram将禁止这些机器人。

07

Telegram报告机器人

HAPPY NEW YEAR

Telegram支持页面可以报告机器人,也可以用 Telegram支持页面报告机器人。

作为一名研究深度造假和潜在危险的人,我无法抗拒对这种技术获得实际见解的诱惑。我开始了一项实验,亲眼目睹它是如何运作的。

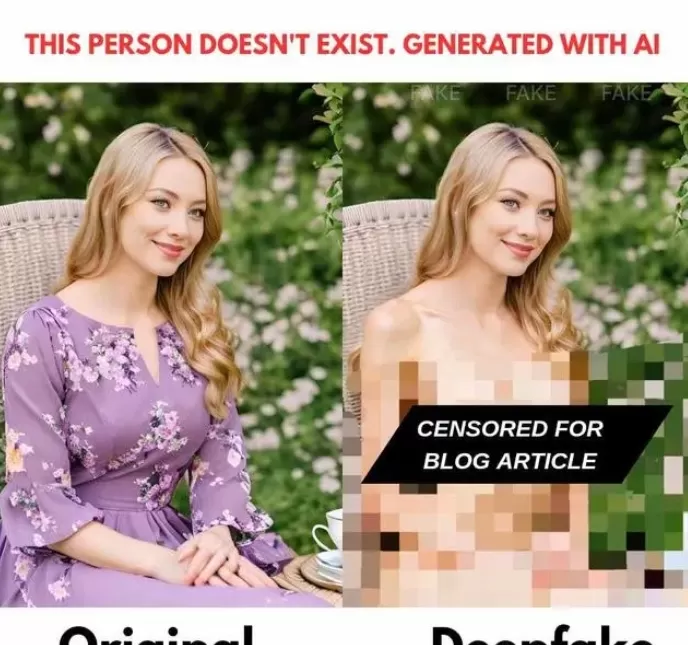

我使用现成的 Deepfake工具在女性模特图像上进行了测试,结果令人震惊又令人不安。

在本实验中,我们试图分析深度伪造工具和机器人,不使用真人图像,所有图像均由人工智能生成。我们确保隐私和同意不受损害。

我们收集了50多个 Deepfake工具和 Telegram机器人,并创建了人工智能生成的虚构女模特图像。每个工具和机器人上的测试图像都是由人工智能生成的。即使对熟悉 Deepfakes的人来说,结果也非常真实。

这一点也不奇怪——就像你知道我们会看到技术对世界产生的影响一样——但你不了解这项技术会做什么。这是显示该技术功能的输出图像之

08

Deepfake的图像

HAPPY NEW YEAR

Deepfake的图像与原始图像几乎没有区别,但这项技术却很危险。因为它以惊人的准确性产生欺骗性内容,使人难以辨别。它的危险在于,它可能被滥用来操纵和欺骗,这意味着人们会面临隐私侵犯、声誉受损和情绪困扰的风险。这就是为什么我们需要提高对深度造假的认识,负责任地使用人工智能,并采取强有力的措施来减轻其对社会的负面影响。

如“伪造”新闻、假照片或视频。如果它被滥用,它可能会被操纵和欺骗,这会导致个人面临隐私侵犯、声誉受损和情绪困扰的风险。对于政府和大型科技公司而言,他们是打击深度造假的责任主体,需要了解与深度造假相关的风险,并采取强有力的措施来减轻其对社会的负面影响。政府和大型科技公司需要为打击深度造假提供政策支持和法律保障,并通过投资能够检测和防止深度造假内容传播的技术来发挥关键作用。

09

应对深度造假负责

HAPPY NEW YEAR

为了有效应对深度造假,政府和大型科技公司应该承担起责任。这可以通过制定规则、发布准则或通过其他方式来实现。个人也可以倡导变革,而不是等待政府或大型科技公司来采取行动。[模板]和大型科技公司应该加强政策和法律,并投资能够检测和防止深度[模板]内容传播的技术。

10

作为[模板]

HAPPY NEW YEAR

我们可以提高对深度造[模板]认识,并鼓励对此问题的讨论。通过了解并直言不讳地了解这些技术的影响,我们可以共同推动必要的变革,以确保为所有人提供更安全的数字环境。

如果有人对您或您认识的人进行深度伪造,您需要坚定且不要妥协,并根据当地或国家/地区的法律向警方投诉他/她。目前,印度缺乏禁止或控制深度造假技术使用的具体法律或法规。

现有法律中的某些条款可能适用于解决 Deepfake的某些方面,例如诽谤和传播明确材料。咨询律师可以帮助您了解您所在司法管辖区可用的法律选择。

政府和大型科技公司正在意识到深度造假和人工智能对个人、社会和经济造成的影响和风险。政府正在制定新政策和严格法律,以防止恶意使用深度伪造品。

Adobe、微软、英特尔、索尼、 Truepic和 BBC等公司在C2PA的帮助下合作解决互联网上的虚假和被操纵内容问题。这些公司都已经采取了行动,包括在其媒体平台上发布关于深度伪造的内容,并使用安全更新来纠正这些内容。

11

C2PA建议:

HAPPY NEW YEAR

我们呼吁企业负责任地利用技术的力量,为我们的社区提供更安全的数字环境,让女性能够蓬勃发展,而不必担心成为深度伪造操纵的受害者。我们呼吁企业采取措施保护我们的隐私、[模板]和[模板]价值,并促进技术在安全数字环境中的应用。我们呼吁[模板]制定[模板]策,以[模板]对 Deepfake内容的传播,并以更严格、更透明和更负责任的方式对待 Deepfake技术。

让我们负责任地利用技术的力量,保护每个人的完整性和尊严,无论性别。

在了解 Deepfake的过程中,我们需要知道它的危险和阴暗面,因为我们都不希望在自己的社交媒体上看到这样的照片。

印修制作,转载请备注!

提示:在享受本文内容的同时,请注意版权归属 徐州鑫坤机电设备有限公司https://www.xzxkjd.com如果您觉得有价值欢迎分享,但请务必注明出处,感谢您的理解,谢谢!

以下部分内容需要登录查看 立即登录

简体中文

简体中文 繁體中文

繁體中文 English

English Nederlands

Nederlands Français

Français Русский язык

Русский язык Polski

Polski 日本語

日本語 ภาษาไทย

ภาษาไทย Deutsch

Deutsch Português

Português español

español Italiano

Italiano 한어

한어 Suomalainen

Suomalainen Gaeilge

Gaeilge dansk

dansk Tiếng Việt

Tiếng Việt Pilipino

Pilipino Ελληνικά

Ελληνικά Maori

Maori tongan

tongan ᐃᓄᒃᑎᑐᑦ

ᐃᓄᒃᑎᑐᑦ ଓଡିଆ

ଓଡିଆ Malagasy

Malagasy Norge

Norge bosanski

bosanski नेपालीName

नेपालीName čeština

čeština فارسی

فارسی हिंदी

हिंदी Kiswahili

Kiswahili ÍslandName

ÍslandName ગુજરાતી

ગુજરાતી Slovenská

Slovenská היברית

היברית ಕನ್ನಡ್Name

ಕನ್ನಡ್Name Magyar

Magyar தாமில்

தாமில் بالعربية

بالعربية বাংলা

বাংলা Azərbaycan

Azərbaycan lifiava

lifiava IndonesiaName

IndonesiaName Lietuva

Lietuva Malti

Malti català

català latviešu

latviešu УкраїнськаName

УкраїнськаName Cymraeg

Cymraeg ກະຣຸນາ

ກະຣຸນາ తెలుగుQFontDatabase

తెలుగుQFontDatabase Română

Română Kreyòl ayisyen

Kreyòl ayisyen Svenska

Svenska հայերեն

հայերեն ဗာရမ်

ဗာရမ် پښتوName

پښتوName Kurdî

Kurdî Türkçe

Türkçe български

български Malay

Malay मराठीName

मराठीName eesti keel

eesti keel മലമാലം

മലമാലം slovenščina

slovenščina اوردو

اوردو አማርኛ

አማርኛ ਪੰਜਾਬੀName

ਪੰਜਾਬੀName albanian

albanian Hrvatski

Hrvatski Suid-Afrikaanse Dutch taal

Suid-Afrikaanse Dutch taal ខ្មែរKCharselect unicode block name

ខ្មែរKCharselect unicode block name